Table Of Content

Ce este Crawl Budget si de ce site-ul tau s-ar putea sa fie invizibil pentru Google (fara sa fie vina continutului)

Daca ai un site mare si ai observat ca pagini noi pur si simplu nu apar in Google, desi continutul e “top”, s-ar putea sa nu ai o problema de SEO clasic, ci una de logistica. Mai exact, de Crawl Budget.

Sincer, nu e cel mai spectaculos subiect din lume — nu e despre creativitate sau copywriting — dar in practica, e diferenta dintre un site care “rupe” si unul pe care Google il ignora cu lunile. Am vazut cazuri unde sute de produse de e-commerce stateau in “umbra” doar pentru ca bot-ul Google se pierdea in filtre inutile.

Ce este crawl budget-ul, de fapt?

Crawl budget reprezinta numarul maxim de pagini pe care Googlebot le acceseaza si le indexeaza pe un site intr-un interval de timp determinat. Acesta este influentat de performanta serverului si de autoritatea continutului, fiind critic pentru indexarea rapida a site-urilor mari.

- Crawl Capacity (Capacitatea): Cat de multe cereri poate sustine serverul tau simultan fara sa incetineasca. Daca site-ul se incarca greu, Googlebot reduce frecventa vizitelor pentru a proteja experienta utilizatorilor.

- Crawl Demand (Cererea): Cat de valoros este site-ul pentru Google. Daca ai continut de calitate, actualizat frecvent si autoritate (backlinks), Googlebot va reveni mai des pentru a descoperi pagini noi.

Cand ar trebui sa incepi sa iti faci griji?

Nu orice blog de nisa sau site de prezentare trebuie sa isi bata capul cu asta. Daca ai sub 500-1000 de pagini, Google te va indexa probabil fara efort, chiar daca site-ul nu e perfect. Dar, daca te afli in una din situatiile de mai jos, ai o problema reala de business, nu doar de SEO:

- Ai un magazin online “stufos”

- Daca ai mii de produse si fiecare are variante de marimi, culori sau materiale, poti ajunge rapid la zeci de mii de URL-uri. Fara o strategie, Google se va bloca in filtre si nu va ajunge niciodata la produsele noi sau la cele la promotie.

- Statusul frustrant din Search Console

- Daca vezi raportul “Discovered – currently not indexed” crescand de la o saptamana la alta, e cel mai clar semn. Google stie ca paginile exista, dar a decis ca “nu merita efortul” sa le viziteze acum pentru ca site-ul tau l-a obosit deja cu alte pagini inutile.

- Structura “adanca” (Deep Architecture)

- Regula mea e simpla: daca un utilizator trebuie sa dea mai mult de 3 click-uri de la Home Page ca sa gaseasca un produs, probabil nici Googlebot nu va depune acel efort constant. Paginile “ingropate” sunt primele care raman fara buget de crawl.

- Publici continut in volum mare

- Daca esti un site de stiri sau un portal de anunturi care scoate zeci de pagini pe zi, ai nevoie ca Google sa fie “la usa ta” in fiecare minut. Orice secunda pierduta pe erori tehnice inseamna stiri care apar in cautari cand deja sunt vechi.

“Capcanele” care iti mananca resursele

Aici e locul unde majoritatea pierd batalia cu algoritmii. Daca nu esti atent, bugetul tau de crawl se “scurge” prin niste gauri negre tehnice fara sa aduca niciun beneficiu SEO. Iata unde se pierde energia:

| Capcana (Crawl Trap) | Ce se intampla de fapt? | Impact SEO | Solutie Rapida |

|---|---|---|---|

| URL-uri Dinamice | Google se pierde in mii de combinatii de filtre (?culoare=, ?pret=). | Risipa masiva de buget pe pagini duplicate. | Blocheaza parametrii in robots.txt sau foloseste canonical. |

| Continut Slab (Thin) | Bot-ul scaneaza pagini de tag-uri goale sau cautari interne fara rezultate. | Scade autoritatea perceputa a site-ului. | Aplica tag-ul noindex sau sterge paginile inutile. |

| Erori 404 & Redirect-uri | Google loveste “usi inchise” (404) sau lanturi lungi de redirect-uri (A -> B -> C). | Bot-ul abandoneaza site-ul si pleaca la concurenta. | Curata Sitemap-ul si repara periodic link-urile moarte. |

| JavaScript Greoi | Google consuma resurse uriase (CPU) pentru a randa scripturi in loc sa citeasca textul. | Indexare foarte lenta sau incompleta a continutului. | Implementeaza Server-Side Rendering (SSR) pentru continutul critic. |

| Structura Adanca | Paginile importante sunt “ingropate” la mai mult de 4-5 click-uri de Home. | Paginile esentiale nu sunt vizitate aproape niciodata. | Foloseste Internal Linking si regula de “maxim 3 click-uri”. |

Strategia de optimizare a Crawl Budget-ului

Optimizarea bugetului de crawl nu se bazeaza pe trucuri, ci pe respectarea fundamentelor tehnice. Aceasta este strategia standard, utilizata la nivel global pentru a asigura o indexare eficienta:

- Gestionarea accesului prin Robots.txt

Conform bunelor practici, prima linie de aparare este fisierul robots.txt. Acesta este utilizat pentru a impiedica Googlebot sa acceseze zonele care nu ofera valoare utilizatorilor din cautari.

Ce se blocheaza: Paginile de login, sectiunile de administrare, cautarile interne sunt cateva optiuni.

Se recomanda blocarea acestor zone din robots.txt pentru a opri consumul de resurse, deoarece tag-ul noindex permite totusi accesul bot-ului pe pagina, irosind bugetul. - Maximizarea vitezei de raspuns a serverului

Google confirma oficial ca viteza de incarcare este un factor determinant pentru crawl rate. Un site rapid permite scanarea unui numar mai mare de pagini in acelasi interval de timp. Un Time to First Byte (TTFB) sub 200ms.

- Mentinerea unui Sitemap XML curat

Sitemap-ul reprezinta declaratia oficiala a site-ului despre care sunt paginile cele mai importante. Standardul SEO impune o igiena stricta a acestui fisier. In sitemap ar trebuie sa apara doar URL-uri cu cod de raspuns 200 OK.

- Arhitectura ierarhica a informatiilor

O strategie SEO completa include optimizarea structurii de linkuri interne. Standardul de industrie este “Flat Site Architecture”. Orice pagina esentiala trebuie sa fie accesibila in maxim 3 click-uri de la Home Page. Linkurile interne transmit “autoritate” (Link Equity) si ghideaza bot-ul catre sectiunile prioritare.

Studii de caz: Impactul optimizarii in cifre reale

Pentru a intelege cat de mult conteaza aceste setari tehnice, iata trei scenarii frecvente unde optimizarea bugetului de crawl a schimbat radical vizibilitatea in motorul de cautare:

Scenariul 1: Eficientizarea unui E-commerce (Cresterea indexarii cu 40%)

- Problema: Un magazin online cu mii de produse avea peste 70% din activitatea Googlebot irosita pe URL-uri generate de filtre (sortare dupa pret, marime, culoare). Produsele noi ramaneau neindexate saptamani intregi.

- Solutia: Blocarea parametrilor de filtrare in fisierul robots.txt.

- Rezultatul: In doar 2-3 saptamani, Googlebot a inceput sa prioritizeze URL-urile de produs, iar rata de indexare a paginilor noi a crescut cu 40%.

Scenariul 2: Portal de stiri (Crestere in Google Discover)

- Problema: Un site de stiri observa ca Google pierdea resurse scanand arhive vechi din 2018, in timp ce articolele de ultima ora erau procesate lent.

- Solutia: Reorganizarea arhitecturii de link-uri interne pentru a prioritiza categoriile actuale si eliminarea link-urilor catre arhivele vechi din zonele de navigare principala.

- Rezultatul: O indexare aproape instanta a stirilor noi si o crestere imediata a prezentei in Google Discover, datorita prospetimii continutului (freshness).

Scenariul 3: Optimizarea performantei (Triplarea frecventei de crawl)

- Problema: Un site cu autoritate mare avea un server care raspundea greu (TTFB mare), ceea ce limita numarul de pagini pe care Google decidea sa le acceseze zilnic.

- Solutia: Upgrade la o solutie de hosting performanta si optimizarea interogarilor in baza de date.

- Rezultatul: Googlebot “a simtit” ca serverul este mai stabil si poate sustine o incarcare mai mare, astfel ca frecventa vizitelor pe site s-a triplat in mai putin de o luna.

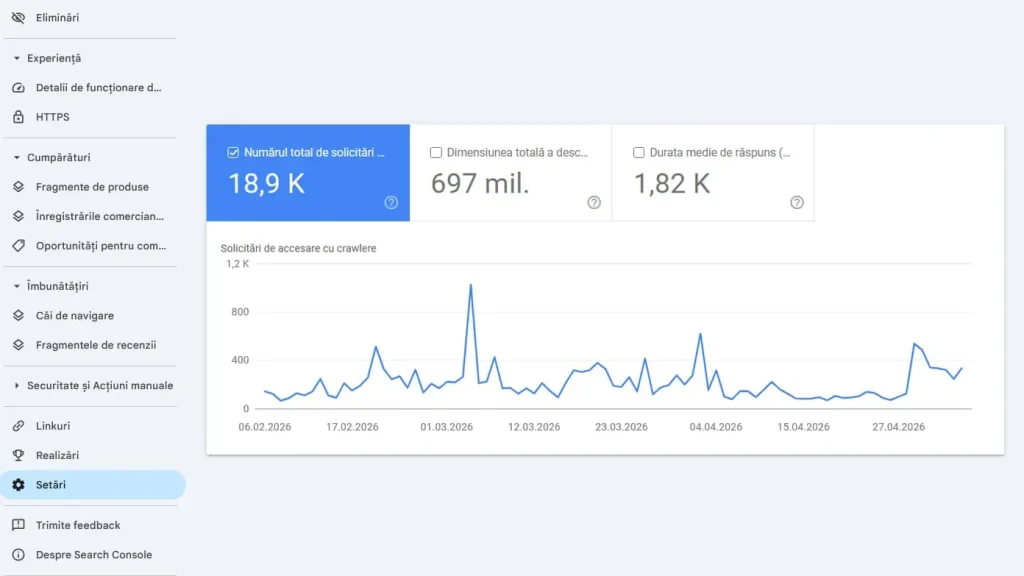

Ce trebuie sa urmaresti in Google Search Console

Nu trebuie sa fii programator sau sa stii cod ca sa intelegi cum interactioneaza Google cu site-ul tau. Totul este vizibil in sectiunea Settings -> Crawl Stats.

Daca graficul tau arata ca o “electrocardiograma” cu varfuri uriase urmate de scaderi bruste, sau daca linia timpului de raspuns (Response Time) urca constant, e un semn clar: Google se chinuie pe site-ul tau.

Iata semnalele de alarma la care sa fii atent:

- Varfurile de crawl pe pagini inutile: Daca vezi un volum mare de solicitari pe URL-uri care contin parametri (ex: ?filter_), inseamna ca pierzi buget.

- Timpul de raspuns (Latency): Ideal e sa ai o linie cat mai constanta si cat mai jos. Daca timpul de raspuns trece de 500-600ms, Googlebot va incepe sa viziteze mai putine pagini pentru a nu suprasolicita serverul.

- Statusul 200 OK: In mod ideal, peste 95% din cereri ar trebui sa fie “OK”. Daca vezi multe erori 404 sau 5xx, e timpul sa faci curatenie.

Viitorul: Google si AI

Lumea SEO se schimba fundamental sub ochii nostri. In era AI Overviews (SGE) si a motoarelor de cautare bazate pe inteligenta artificiala, Google devine mult mai selectiv cu resursele sale.

De ce este Crawl Budget-ul si mai important acum?

- Eficiența procesarii

- Google nu mai vrea sa indexeze “tot internetul”, ci doar partile care ofera valoare reala. Indexarea este costisitoare, iar AI-ul are nevoie de date curate pentru a genera raspunsuri.

- Sursa de date pentru AI

- Daca site-ul tau este un haos tehnic si bot-ul ramane blocat in filtre, nicio inteligenta artificiala nu va ajunge la expertiza ta. Ca sa fii citat ca sursa in raspunsurile generate de AI, trebuie sa fii, in primul rand, usor de gasit.

- Prioritizarea calitatii

- Google incepe sa trateze bugetul de crawl ca pe un vot de incredere. Daca site-ul tau este rapid si eficient, vei primi o “cota” mai mare de atentie. Daca este greoi, vizibilitatea ta va fi limitata drastic.

Concluzie

Crawl budget-ul nu este doar o setare pentru roboti, ci este despre respectul pentru resurse si eficienta business-ului tau online. Intr-un internet saturat de informatie, Google nu iti datoreaza indexarea; tu trebuie sa i-o facilitezi. Daca ii faci munca usoara lui Google, el te va rasplati cu o indexare mai rapida, o prezenta mai stabila in rezultate si, in final, cu o vizibilitate mai buna in fata clientilor tai.

Mesajul este simplu: Incepe prin a inchide usile catre zonele inutile ale site-ului si lasa “drumul liber” catre continutul tau valoros. In SEO modern, castiga cei care simplifica drumul de la bot la informatie.

FAQ

In mod direct, nu. Google are suficiente resurse pentru a scana un site mic. Totusi, optimizarea vitezei si eliminarea erorilor 404 raman importante pentru experienta utilizatorului (UX) si pentru “sanatatea” generala a site-ului, chiar daca nu ai probleme de buget.

Da. Daca te muti pe un server mai rapid si mai stabil, Googlebot va observa imbunatatirea timpului de raspuns si, in timp, va creste limita de crawl (Crawl Capacity). Invers, un hosting ieftin si lent poate limita drastic numarul de pagini scanate zilnic.

Absolut. Orice resursa pe care Googlebot trebuie sa o descarce (imagini, PDF-uri, fisiere video, documente Word) consuma o parte din buget. Daca ai mii de imagini neoptimizate, acestea pot “fura” din timpul alocat indexarii paginilor de text.

Da, si sunt extrem de importante. Googlebot are nevoie de CSS si JS pentru a “randa” pagina (sa vada cum arata ea in realitate). Daca blochezi aceste fisiere in robots.txt, Google nu va putea intelege design-ul site-ului tau, ceea ce poate afecta ranking-ul pe Mobile-Friendly.

Nu este un proces instantaneu. Daca repari problemele tehnice astazi, te poti astepta la o schimbare a comportamentului Googlebot in decurs de cateva zile pana la cateva saptamani. Google invata constant cat de mult “poate duce” serverul tau.

Nu neaparat. Desi Googlebot ar putea sa nu urmareasca acel link specific, el poate descoperi aceeasi pagina prin alte cai (sitemap, link-uri externe). Cea mai sigura metoda de a salva buget ramane blocarea din robots.txt.

Da. Site-urile cu autoritate mare (multe backlink-uri de calitate) au un “Crawl Demand” mai mare. Google considera acele site-uri mai importante si le viziteaza mult mai des decat pe cele noi sau fara autoritate.